Cómo va a afectar la Inteligencia Artificial las elecciones en 2024

Inteligencia Artificial y elecciones, un desafío para 2024 para el que debemos estar preparados. Promete beneficios, pero sobre todo riesgos e incertidumbres.

2024 va a ser un año clave para la democracia debido al gran número de elecciones que se van a llevar a cabo y la gran incidencia que van a tener en la nueva conformación de gobiernos a nivel mundial.

CluPad es una publicación que cuenta con el respaldo de los lectores. Para recibir nuevos posts y apoyar mi trabajo, considera convertirte en un suscriptor gratis o de pago.

Si se utiliza responsablemente, podemos encontrar en la IA un aliado para fortalecer la democracia, pero esta podría ser utilizada por actores malintencionados para suprimir votos, difamar candidatos e incitar a la violencia, entre otras amenazas. Tanto las nuevas empresas que ofrecen IA generativa como las más antiguas han reducido sus equipos de integridad electoral, lo que podría llevar a problemas de desinformación y manipulación electoral. La IA es solo uno de los muchos problemas a los que se enfrentan los funcionarios electorales. Y el reto está en como regular el discurso online y la tensión entre la libertad de expresión y la necesidad de combatir la desinformación.

Índice de contenidos

¿Es reciente el uso de Inteligencia Artificial en política?

La influencia de la inteligencia artificial en la comunicación política no es un fenómeno reciente. Ya en 1996, Paletz destacó preocupaciones sobre el potencial de la tecnología de información avanzada, incluyendo la IA, para alimentar el populismo y la demagogia. En años posteriores, investigaciones como las de Tichy (2018) y Barredo-Ibáñez (2021) han resaltado el uso creciente de la IA, especialmente en procesamiento del lenguaje natural, en campañas electorales y según Egleton (2020) existe la necesidad de tener un marco legal para su regulación.

Bykov (2020) también enfatizó la importancia del empleo de la IA en la comunicación política. Sin embargo, es con la llegada de la inteligencia artificial generativa en 2023 que se marca un punto de inflexión significativo. López-López (2023) subraya la creciente importancia de la comunicación política digital y el papel de la IA en la difusión de desinformación, mientras que Sannikova (2023) recalca los efectos negativos de los bots políticos y la importancia de la transparencia en los sistemas de IA. Estas contribuciones académicas revelan cómo la IA, si bien ha mejorado la comunicación política, también plantea importantes desafíos éticos y regulatorios.

IA y comunicación política

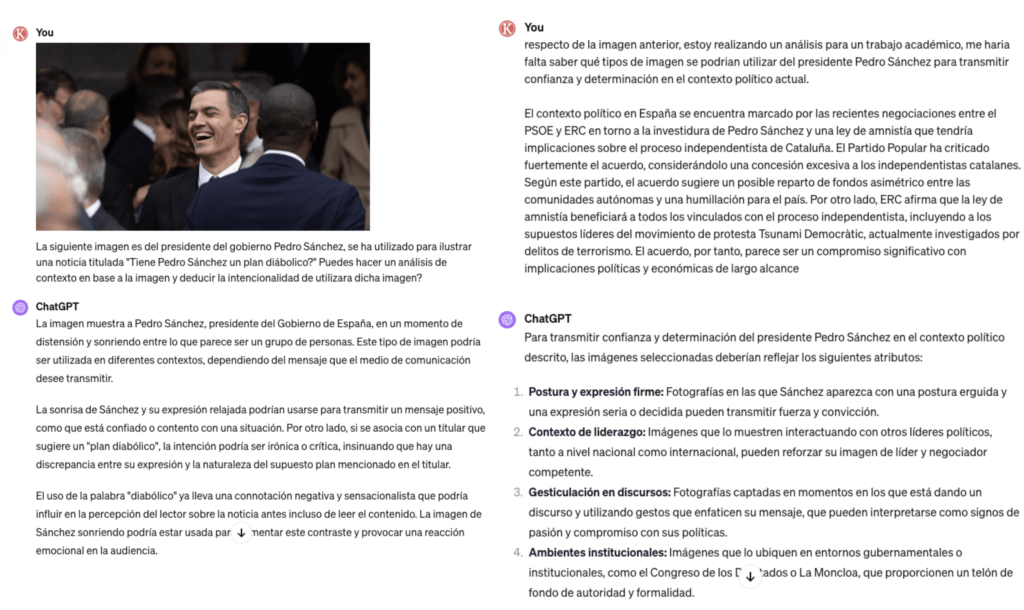

La llegada de la Inteligencia Artificial (IA) generativa ha marcado un antes y un después en el ámbito político, especialmente en la comunicación política. Ésta ha abierto nuevas fronteras en la forma de crear y difundir mensajes, permitiendo la generación de discursos, textos legislativos simplificados, y contenido personalizado para campañas a una velocidad y escala sin precedentes. Herramientas como ChatGPT han demostrado ser fundamentales en la construcción de narrativas políticas, ofreciendo la capacidad de adaptarse a diferentes perspectivas y estilos de comunicación.

Sin embargo, esta revolución no está exenta de desafíos, como la necesidad de supervisar estrechamente la exactitud y el sesgo en los contenidos generados. La aparición de roles especializados como el de ‘Spin Prompter‘ subraya la importancia de una interacción cuidadosa y estratégica con estas herramientas, asegurando que la IA no solo amplifique el mensaje político, sino que también respete la sensibilidad y la ética inherentes a la comunicación política.

En resumen, la IA generativa no solo ha transformado la eficiencia y el alcance de la comunicación política, sino que también ha planteado nuevas consideraciones éticas y estratégicas en este campo.

Desde la campaña presidencial de Donald Trump en 2016, donde la IA jugó un papel crucial en la elaboración de mensajes y estudios sociológicos, hasta el uso de tecnologías como deepfake en India contra mujeres políticas y periodistas, la IA ha demostrado su poder y versatilidad. Actualmente, se considera inevitable que la nueva forma de hacer política incorpore herramientas de IA y otros apoyos tecnológicos en las estrategias de campaña y comunicación.

Inteligencia Artificial y elecciones ¿Cómo se está utilizando la IA en política y procesos electorales?

La IA ya está siendo utilizada en las campañas presidenciales de 2024 en Estados Unidos (y seguro que en muchas otras también). La IA está activa en agencias gubernamentales y en las campañas de candidatos y funcionarios electos, ayudando con el análisis de datos e identificando patrones de votación, redacción de discursos y materiales de campaña, y en la comunicación con los electores. Aunque a pesar de sus beneficios, la integración de la Inteligencia Artificial probablemente permanecerá en segundo plano, al menos en el plano más visible, debido a la desconfianza del público y la falta de regulación.

La IA ya se está utilizando en el ámbito político con el uso de modelos de lenguaje generativo para crear correos electrónicos de campaña y mensajes de texto. También ya es habitual el uso de herramientas de edición de video y foto, como Adobe Firefly, para crear anuncios políticos con elementos añadidos digitalmente. Además, ya hay startups que desarrollan modelos de lenguaje propios para asistir a las campañas políticas.

¿Real o falso?

Uno de los elementos que van a ser clave en todos estos procesos democráticos va a ser el uso de la Inteligencia artificial para generar deepfakes y desinformar. A estas alturas ya podemos ver a políticos de todo el mundo que están utilizando la inteligencia artificial como chivo expiatorio (excusa) para descartar evidencias desfavorables contra ellos, alegando que son generadas por IA. Esta táctica socava la verdad y desestabiliza el concepto de realidad, especialmente porque los deepfakes se han vuelto más sofisticados. Las empresas tecnológicas aún no han tomado suficientes medidas significativas para regular el contenido generado por IA (que le preguntes a Elon Musk por Grok y Twitter), dejando a los expertos como los únicos capaces de verificar su autenticidad. Como resultado, el público queda vulnerable a los medios manipulados que pueden impactar potencialmente en los resultados políticos y la estabilidad mundial.

En un episodio del podcast “The TechTank” de Darrell M. West y Elaine Kamarck discuten cómo la inteligencia artificial está transformando el panorama político, especialmente en las campañas electorales. Se destaca el uso de deepfakes y voces generadas por IA, lo que complica la distinción entre contenido real y falso. El debate se centra en la seguridad e integridad de los procesos electorales, con preocupaciones planteadas por figuras políticas sobre el uso de IA en estrategias de campaña y la necesidad de transparencia y medidas regulatorias para preservar la autenticidad del discurso político. Es una preocupación generalizada y que podemos ver en todo tipo de medios y de instituciones.

Desinformación y manipulación

El informe “Global Risks Report 2024” del Foro Económico Mundial destaca la desinformación y la manipulación generadas por IA como unos de los mayores riesgos globales en 2024. Este informe, que prioriza estos riesgos sobre otros como el cambio climático y conflictos armados, subraya el impacto potencial de la IA en la polarización social y la seguridad de las elecciones. Expertos y líderes de la industria han expresado su preocupación por cómo la IA podría influir en la opinión pública y alterar resultados electorales, llamando a una cooperación global y la creación de salvaguardias contra los riesgos emergentes más disruptivos.

En este sentido y por poner un ejemplo según un informe de AI Forensics el chatbot Bing de Microsoft proporcionó información errónea en un 30% de las consultas electorales básicas que se hicieron en las recientes elecciones de Alemania y Suiza. Se descubrió que Bing dio respuestas incorrectas sobre candidatos, encuestas, escándalos y votaciones. El chatbot a menudo citaba incorrectamente sus fuentes y el problema fue más común cuando las preguntas se hicieron en idiomas distintos al inglés.

Aunque no solo es la IA la que puede generar desinformación. Las restricciones de internet en las elecciones de 2024 son otro punto clave a tener en cuenta. Según un informe de Surfshark, de los 90 países con elecciones en 2024, 12 han restringido el acceso a internet en elecciones anteriores. Estas restricciones incluyen cortes totales de internet y limitaciones en el uso de redes sociales. Con 29 casos desde 2015, África Subsahariana lidera en restricciones de internet, seguida por el sur de Asia. Estas prácticas pueden socavar la autenticidad y equidad de las elecciones y reflejan una tendencia más amplia de los gobiernos a suprimir derechos digitales.

¿Cómo evitamos que la IA eche a perder las elecciones?

La disminución de personal en plataformas tecnológicas y la propagación de contenido falso o engañoso plantean serios retos para la integridad electoral. Los despidos y las fusiones han dejado bajo recursos a muchas plataformas de redes sociales y utilizar IA para combatir la propia IA a veces lleva a un camino sin salida.

Las empresas y gobiernos están abordando los desafíos de la IA y la desinformación en las elecciones de varias maneras. Están implementando políticas y sistemas para detectar y moderar contenido generado por IA, estableciendo marcos regulatorios y colaborando en iniciativas internacionales. Además, están invirtiendo en tecnologías para identificar y combatir la desinformación, y promoviendo la cooperación entre el sector público y privado para enfrentar estos retos emergentes de manera efectiva.

Desde la Unión Europea se ha publicado el documento “Artificial intelligence, democracy and elections” desde el European Parliamentary Research Service. Este documento analiza el impacto de la inteligencia artificial en la democracia y las elecciones. Se enfoca en cómo la IA puede actuar como catalizador de la democracia, mejorando el compromiso político y la eficiencia en la formulación de políticas. Sin embargo, también aborda los riesgos de desinformación y mala información impulsados por la IA, que pueden desencadenar conflictos electorales y violencia. A pesar de estos riesgos, sugiere que la IA puede ser beneficiosa para las democracias si se aplican medidas adecuadas, como herramientas para detectar contenido generado por IA y técnicas de marca de agua. El documento también revisa el marco legal de la UE relacionado con la IA, incluyendo el Código de Prácticas sobre Desinformación y la Ley de Servicios Digitales, destacando la necesidad de sistemas de IA confiables, transparentes y responsables.

Desde OpenAI, creadora de ChatGPT y DALL·E, se comprometen a prevenir el abuso, fomentar la transparencia y asegurar la integridad de las elecciones en todo el mundo. Están trabajando para anticiparse y prevenir el mal uso potencial de sus herramientas, especialmente en el contexto electoral. Están implementando medidas para detectar y abordar el abuso, como identificar contenido generado por IA y prevenir la creación de chatbots que imitan a candidatos. En este sentido se introducirá un sistema de credenciales y marca de agua digital de la Coalición para la Proveniencia y Autenticidad del Contenido (C2PA) para identificar imágenes generadas por IA. Además, se implementará una función de “reporte” para usuarios, permitiéndoles señalar posibles violaciones en el uso de GPTs personalizados. OpenAI también planea lanzar un clasificador de procedencia para detectar imágenes generadas por DALL-E, incluso si han sido modificadas.

Otras empresas también están tomando medidas. Google planea restringir las respuestas de su chatbot Bard y la experiencia de búsqueda generativa relacionada con las elecciones, aplicando estas restricciones a principios de 2024. Por otro lado, Meta ha declarado que prohibirá que las campañas políticas utilicen sus nuevos productos de publicidad generados por IA y requerirá que los anunciantes políticos revelen cuando utilicen herramientas de IA para modificar o crear anuncios en Facebook e Instagram.

También podemos ver iniciativas de regulación más en primera persona, como las que propone el demócrata californiano Ro Khanna, quien aborda la regulación de la inteligencia artificial, la privacidad y las redes sociales, y cómo estos temas se relacionan con la elección presidencial de 2024. Propone medidas para identificar claramente lo que está generado por humanos y lo que está generado por IA y para tener precauciones básicas para evitar que la IA genere desinformación masiva o riesgos para la democracia. Khanna también enfatiza la importancia de la privacidad y la necesidad de fomentar la competencia en el sector tecnológico, especialmente en un año electoral donde la desinformación podría ser un desafío significativo.

Más allá de como se puede evitar el lado oscuro de la IA, esta también podría fortalecer la democracia. Se puede utilizar para identificar estrategias innovadoras contra la violencia electoral y la subversión, y para fortalecer la democracia. El proyecto Governance Lab utiliza la inteligencia artificial para descomponer desafíos complejos en problemas más manejables, particularmente en el ámbito de la subversión electoral (injerencias en el proceso de recuento de votos). La IA se emplea para organizar y resumir contenido, lo que facilita la identificación de estrategias innovadoras para combatir problemas relacionados con las elecciones y fortalecer la democracia. Una herramienta clave en este proceso es Policy Synth, desarrollada para acelerar la definición de problemas y la generación de soluciones, utilizando una versión ajustada del modelo de lenguaje GPT-4 de OpenAI. Policy Synth automatiza la creación de consultas de búsqueda para identificar problemas y sus causas raíz, ayudando a desglosar la subversión electoral en desafíos más específicos y manejables.

Inteligencia Artificial y elecciones en positivo

Como ya he comentado, la IA puede aportar cosas positivas a las elecciones, por ejemplo:

Mejora de la Comunicación y Participación

- Personalización de mensajes de campaña: Creación de mensajes personalizados para diferentes grupos de votantes.

- Interacción mejorada con los electores: Uso de chatbots para proporcionar información oportuna y precisa a los votantes.

- Educación y concienciación electoral: Programas de IA para educar y concienciar sobre temas electorales clave.

- Facilitación del acceso a información electoral: Aplicaciones basadas en IA que ofrecen información comprensible sobre procesos y candidatos electorales.

Análisis y Gestión de Datos

- Análisis avanzado de datos: Uso de IA para comprender tendencias electorales y necesidades de los votantes.

- Monitoreo y análisis de sentimiento en redes sociales: Análisis de tendencias y sentimientos en redes sociales para entender mejor las preocupaciones de los votantes.

- Análisis de tendencias y predicciones electorales: Modelos de IA para predecir tendencias y posibles resultados electorales.

Eficiencia Operativa y Estrategia

- Mejora de la eficiencia operativa: Automatización de tareas repetitivas para centrarse en estrategias más complejas.

- Optimización de recursos de campaña: Análisis predictivo para una distribución eficiente de fondos y esfuerzos publicitarios.

Seguridad y Transparencia

- Prevención de fraudes y verificación de datos: Identificación y prevención de actividades fraudulentas en el proceso electoral.

- Fortalecimiento de la seguridad digital en infraestructuras electorales: Mejora de la seguridad en infraestructuras electorales para detectar y prevenir ciberataques.

- Sistemas de voto electrónico seguros y confiables: Desarrollo de sistemas de votación electrónica avanzados y seguros.

Accesibilidad e Inclusión

- Traducción y transcreación: Comunicación multilingüe y culturalmente sensible para ampliar el alcance a una base de votantes más diversa.

- Mejora de la accesibilidad para votantes con discapacidad: Herramientas de IA para mejorar la accesibilidad en los procesos electorales.

Contra la Desinformación

- Detección y lucha contra la Desinformación: Sistemas de IA para identificar y desmentir noticias falsas y desinformación.

Inteligencia Artificial y elecciones en negativo

Y por supuesto también tiene sus peligros, por citar los más importantes:

Manipulación y Desinformación

- Supresión de votos y difamación de candidatos: Uso de la IA para difamar a candidatos políticos o suprimir votos.

- Desinformación y manipulación electoral: Empleo de la IA para difundir desinformación o manipular la opinión pública, incluyendo la creación de deepfakes.

- Bots en redes sociales para influir en el discurso público: Uso de bots automatizados para difundir noticias falsas y manipular el discurso público.

- Generación de discursos o declaraciones falsas: Creación de discursos o declaraciones falsas atribuidas a figuras políticas.

- Perfilado y microsegmentación para propaganda engañosa: Uso de IA para analizar datos de votantes y dirigir propaganda política engañosa o polarizante.

- Creación de medios generados por IA para influir en la opinión pública: Uso de IA para crear artículos, blogs, y comentarios en redes sociales que influyen en la opinión pública.

- Falsificación de evidencia electoral: Creación de evidencia falsa de fraude electoral o irregularidades para cuestionar los resultados electorales.

Seguridad y Transparencia Electoral

- Manipulación de sistemas de votación y conteo: Uso de IA para intervenir en sistemas de votación o conteo de votos.

- Automatización de ataques digitales contra infraestructuras electorales: Empleo de IA para realizar ataques a infraestructuras electorales críticas.

- Problemas de autenticidad y verificación de información: Dificultades en la verificación de la autenticidad de contenidos generados por IA.

- Sesgo en algoritmos de IA y su impacto en la información: Implementación de algoritmos con sesgos que pueden influir en la presentación de noticias y contenido.

Impacto Social y Político

- Simulación de apoyo o oposición en línea: Creación de una falsa percepción de apoyo o rechazo a ciertos temas o candidatos.

- Riesgos de polarización social y estabilidad mundial: Impacto de la IA en la polarización social y la estabilidad de los procesos electorales.

- Restricciones de internet y supresión de derechos digitales: Uso de restricciones de internet por gobiernos para socavar la equidad del proceso electoral.

Inteligencia Artificial y elecciones, un arma de doble filo para la democracia

Al reflexionar sobre el papel de la Inteligencia Artificial en los procesos electorales, nos encontramos con un amplio abanico de posibilidades. La IA, con su capacidad para analizar datos, personalizar la comunicación y mejorar la eficiencia, tiene el potencial de ser una herramienta que puede transformar y enriquecer la democracia. Sin embargo, esta misma tecnología, si se utiliza inadecuadamente, puede convertirse en una fuente de desinformación y manipulación, socavando los cimientos de los sistemas electorales. El futuro no es un camino predeterminado, sino que se forja con el uso responsable o irresponsable que se haga de esta tecnología. Por tanto, debemos asegurarnos de que su aplicación no solo sea innovadora, sino también ética y transparente, podemos aprovechar la IA para fortalecer la democracia, manteniendo siempre presente que su impacto, positivo o negativo, dependerá en última instancia del uso que le demos.

Para finalizar

Unos enlaces relacionados de recursos propios sobre el tema para ampliar información:

- Inteligencia artificial y comunicación política. Una conversación con Diego Mota (episodio de podcast de CluPad)

- Inteligencia Artificial y campañas electorales es el tema principal del debate en el que participé en el programa El Mirador de Andalucía de Canal Sur Radio para hablar sobre la utilización de ChatGPT y otras IA generativas en la campaña electoral. Fue un placer compartir con Natalia Barnés y otros tres periodistas esta conversación.

- Artículo de Iago Moreno sobre el tema (en el que también participé) – La IA irrumpe en el 28-M: así la están usando los políticos para rascar votos (y cabrearte)

- Artículo mío publicado en ACOP sobre la incorporación de la IA generativa en los equipos políticos – Del Spin Doctor al Spin Prompter

- A raíz de los últimos comentarios sobre la posibilidad que lleguemos a votar a una IA os dejo el artículo ¿Estamos preparados para que nos gobierne una Inteligencia Artificial? que publiqué en 2019

- Y ya para acabar este artículo que publiqué en K-Government en 2019 sobre el uso de hologramas en política Hologramas, ¿el siguiente paso?

Referencias utilizadas para este artículo

- «AI Will Affect the 2024 Elections | The TechTank Podcast». Brookings. https://www.brookings.edu/articles/ai-will-affect-the-2024-elections-the-techtank-podcast/ (24 de enero de 2024).

- «AI’s Influence on Election 2024». 2024. https://www.wbur.org/onpoint/2024/01/17/ai-influence-election-2024-politics (24 de enero de 2024).

- «Artificial Intelligence, Democracy and Elections | Think Tank | European Parliament». https://www.europarl.europa.eu/thinktank/en/document/EPRS_BRI(2023)751478 (24 de enero de 2024).

- Cahn, Albert Fox, y Bruce Schneier. 2024. «Don’t Talk to People Like They’re Chatbots». The Atlantic. https://www.theatlantic.com/technology/archive/2024/01/chatbots-change-human-communication/677154/ (24 de enero de 2024).

- Cranz, Alex. 2024. «Here’s OpenAI’s Big Plan to Combat Election Misinformation». The Verge. https://www.theverge.com/2024/1/15/24039333/openai-chatgpt-dalle-ai-2024-election-misinformation-plan (24 de enero de 2024).

- Curry, Rachel. 2023. «How 2024 Presidential Candidates Are Using AI inside Their Election Campaigns». CNBC. https://www.cnbc.com/2023/12/17/how-2024-presidential-candidates-are-using-ai-in-election-campaigns.html (24 de enero de 2024).

- David, Emilia. 2024. «California Senator Files Bill Prohibiting Agencies from Working with Unethical AI Companies». The Verge. https://www.theverge.com/2024/1/3/24024258/ai-bill-unethical-ai-california-ban-regulation (24 de enero de 2024).

- Franzen, Carl. 2024. «OpenAI Will Release AI Citation and Image Safeguards Ahead of 2024 Global Elections». VentureBeat. https://venturebeat.com/ai/openai-will-release-ai-citation-and-image-safeguards-ahead-of-2024-global-elections/ (24 de enero de 2024).

- Gilchrist, Karen. 2024. «Election Disruption from AI Poses the Biggest Global Risk in 2024, Davos Survey Warns». CNBC. https://www.cnbc.com/2024/01/10/wef-ai-election-disruption-poses-the-biggest-global-risk-in-2024.html (24 de enero de 2024).

- Goldman, Sharon. 2023. «AI Will Make 2024 US Elections a ‘Hot Mess’». VentureBeat. https://venturebeat.com/ai/ai-will-make-2024-us-elections-a-hot-mess/ (24 de enero de 2024).

- Goode, Lauren. «AI Hits the Campaign Trail». Wired. https://www.wired.com/story/gadget-lab-podcast-629/ (24 de enero de 2024).

- Heath, Ryan. 2024. «How Bad Actors Could Use Generative AI to Impact Elections This Year». Axios. https://www.axios.com/2024/01/03/ai-elections-politics-chatbots-regulation (24 de enero de 2024).

- «How OpenAI Is Approaching 2024 Worldwide Elections». https://openai.com/blog/how-openai-is-approaching-2024-worldwide-elections (24 de enero de 2024).

- «How Will AI Affect the 2024 Election? | Brennan Center for Justice». https://www.brennancenter.org/events/how-will-ai-affect-2024-election (24 de enero de 2024).

- «How Will Internet Restrictions Impact Elections in 2024?» https://www.digitalinformationworld.com/2024/01/how-will-internet-restrictions-impact.html (24 de enero de 2024).

- Iyengar, Rishi. 2024. «What AI Will Do to Elections». Foreign Policy. https://foreignpolicy.com/2024/01/03/2024-elections-ai-tech-social-media-disinformation/ (24 de enero de 2024).

- Myers, Steven Lee. 2023. «4,789 Facebook Accounts in China Impersonated Americans, Meta Says». The New York Times. https://www.nytimes.com/2023/11/30/technology/facebook-china-fake.html (24 de enero de 2024).

- Noveck, Beth Simone. 2024. «How AI Could Restore Our Faith in Democracy». Fast Company. https://www.fastcompany.com/91001497/ai-faith-in-democracy (24 de enero de 2024).

- Oremus, Will. 2023. «AI Chatbot Got Election Info Wrong 30 Percent of Time, European Study Finds». Washington Post. https://www.washingtonpost.com/technology/2023/12/15/microsoft-copilot-bing-ai-hallucinations-elections/ (24 de enero de 2024).

- Patel, Nilay. 2024. «Rep. Ro Khanna on Regulating Big Tech, Banning TikTok, and the 2024 Election». The Verge. https://www.theverge.com/24046797/ro-khanna-congress-tech-tiktok-regulation-california-politics-decoder-interview (24 de enero de 2024).

- «Pennsylvania Politician Using Talking AI Chatbot to Call Thousands of Voters». Futurism. https://futurism.com/the-byte/pennsylvania-politician-ai-chatbot-voters (24 de enero de 2024).

- «PODCAST | Why It Matters: The Year of AI and Elections». Council on Foreign Relations. https://www.cfr.org/podcasts/year-ai-and-elections (24 de enero de 2024).

- Press, Associated. 2023. «Mark Zuckerberg Donated $500 Million to Harvard for AI. Then a Disinformation Research Project Was Shut down, a Whistleblower Alleges». Fast Company. https://www.fastcompany.com/90992706/mark-zuckerberg-donated-500-million-to-harvard-for-ai-then-a-disinformation-research-project-was-shut-down-a-whistleblower-alleges (24 de enero de 2024).

- Roose, Kevin et al. 2024. «The A.I. Election, Bitcoin’s Wall Street Debut and TikTok’s Doodad Era». The New York Times. https://www.nytimes.com/2024/01/19/podcasts/ai-elections-bitcoin-tiktok.html (24 de enero de 2024).

- Roscoe, Jules. 2023. «Elon Musk’s Grok AI Is Pushing Misinformation and Legitimizing Conspiracies». Vice. https://www.vice.com/en/article/7kxqp9/elon-musks-grok-ai-is-pushing-misinformation-and-legitimizing-conspiracies (24 de enero de 2024).

- Rose, Janus. 2023. «A U.S. Politician Is Robocalling Voters With an AI Chatbot Named ‘Ashley’». Vice. https://www.vice.com/en/article/4a3pvw/shemaine-daniels-congress-ai-chatbot-ashley (24 de enero de 2024).

- «The Washington Post – Breaking News and Latest Headlines, U.S. News, World News, and Video – The Washington Post». Washington Post. https://www.washingtonpost.com/ (24 de enero de 2024).

- Verma, Pranshu, y Gerrit De Vynck. 2024. «AI Is Destabilizing ‘the Concept of Truth Itself’ in 2024 Election». Washington Post. https://www.washingtonpost.com/technology/2024/01/22/ai-deepfake-elections-politicians/ (24 de enero de 2024).

- Vynck, Gerrit De. 2024. «OpenAI Won’t Let Politicians Use Its Tech for Campaigning, for Now». Washington Post. https://www.washingtonpost.com/technology/2024/01/15/openai-election-misinformation-disinformation/ (24 de enero de 2024).